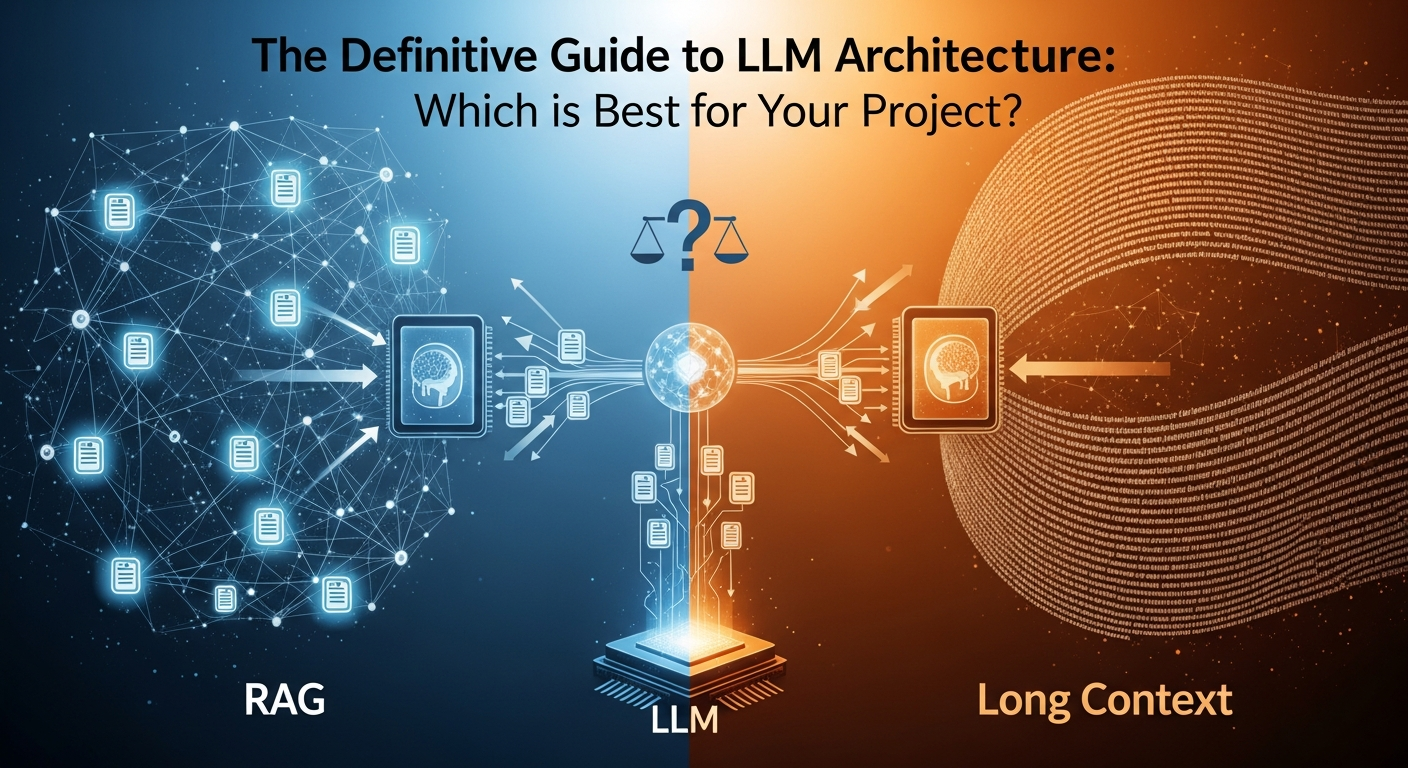

LLM構築の決定版:RAGとLong Context、あなたのプロジェクトに最適なのはどっち?

生成AIを活用したシステム開発において、モデルの知識不足や情報の鮮度をどう補うかは最大の課題です。現在、この解決策として主流となっているのが、外部データベースから情報を引き出す「RAG(検索拡張生成)」と、膨大なデータを直接読み込ませる「Long Context(長文脈)」の2つのアプローチです。本記事では、それぞれの特徴と強みを徹底比較し、開発プロジェクトの目的に合わせた賢い選び方を解説します。

RAGとLong Context:それぞれの仕組みと適正

IBM Technologyによる解説を基に、AIモデルの能力を最大化する2つの主要戦略を紐解きます。それぞれ異なる強みを持つため、ユースケースに応じた使い分けが不可欠です。

Retrieval-Augmented Generation(RAG)の仕組み

RAGは、埋め込みモデルとベクトルデータベースを組み合わせ、関連する情報をLLMに提供する手法です。データは常に外部に存在するため、大規模かつ動的に更新されるデータセットを扱う場合に極めて高い効率を発揮します。必要な情報のみを抜き出して処理するため、計算コストを抑えつつ最新の知識をAIに与えられます。

Long Contextの仕組み

Long Contextは、モデルのコンテキストウィンドウ自体を拡張し、膨大なデータを直接LLMに読み込ませる手法です。外部の検索機構が不要でシステム構成がシンプルになるため、データ全体を網羅的に理解させるようなタスクに最適です。複雑な推論を必要とする文書の分析や要約において、情報の抜け漏れを防ぐ効果が期待できます。

どちらを選ぶべきかの判断基準

選択の鍵は「データの性質」と「推論の範囲」にあります。頻繁に情報が更新される企業ナレッジベースのようなシステムにはRAGが適しており、一方で、法務契約書や長大な書籍のように境界が明確で全体を横断的に理解する必要があるタスクにはLong Contextが適しています。

RAGとLong Contextから見る今後の展望

AI開発におけるインフラの複雑化と最適化は、今後さらに重要な経営課題となります。単なる技術選定を超え、システムの本質的な価値をどう最大化するかについて考察します。

ハイブリッドアーキテクチャへのシフト

今後の展望として、RAGかLong Contextかの二者択一ではなく、両者を組み合わせた「ハイブリッド型」のアプローチが主流になると予測されます。RAGで広範囲の情報を絞り込み、最終的にLong Contextでそれらを統合して詳細に推論させる仕組みです。これにより、計算コストの最適化と精度の高い推論を両立する高度なAIエージェントの構築が進むでしょう。

エンジニアに求められる「本質的なデータ理解」

本件が示唆する重要な点は、AIモデルの性能向上に伴い「何を計算させるか」よりも「データをどう適切に構造化するか」がより一層重要になっているということです。Long Contextの限界やRAGの検索精度など、技術的な制約を理解した上で、自社のデータ特性に最適なアーキテクチャを設計する能力こそが、これからのAIエンジニアやアーキテクトにとって必須のスキルとなります。