AIセラピーの光と影:心のケアに技術はどこまで踏み込めるのか?

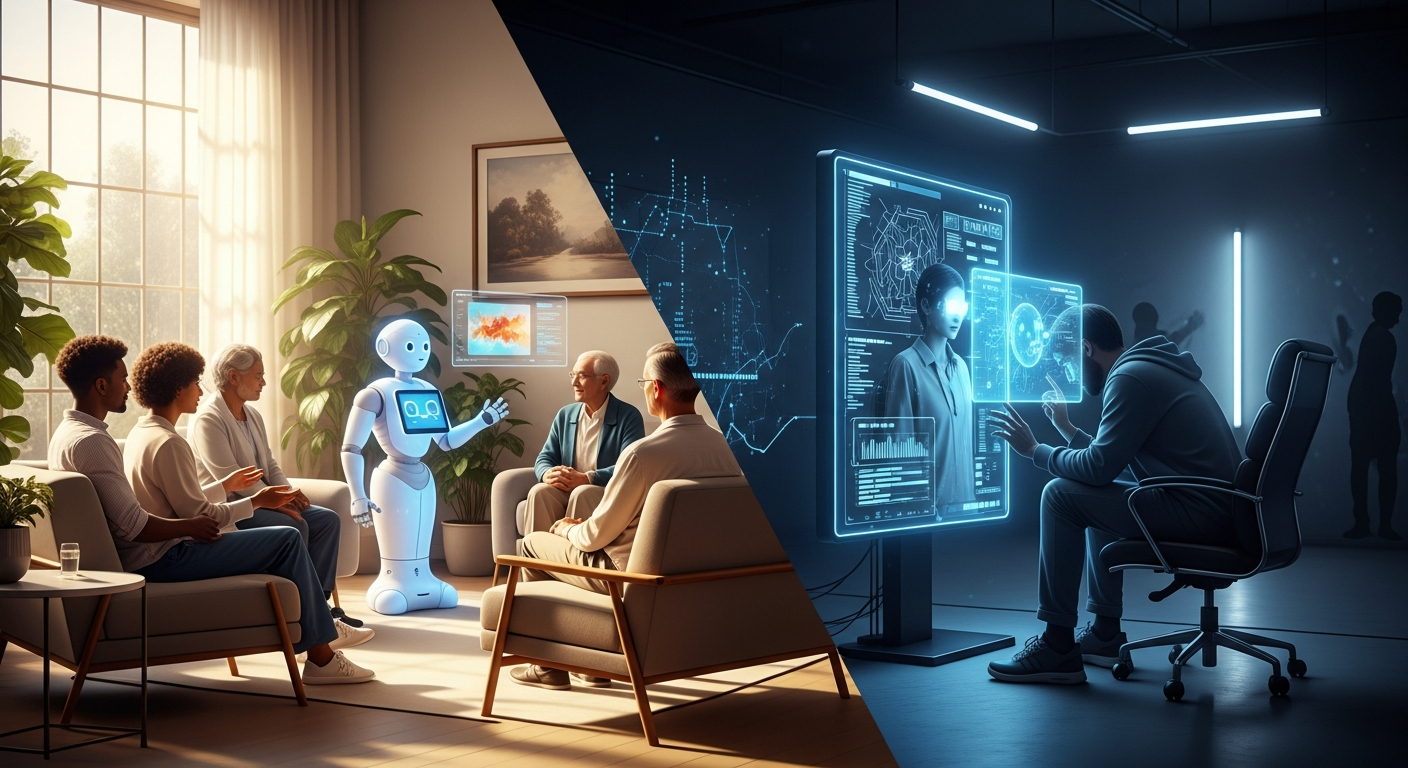

近年、AIを活用したセラピーやメンタルヘルス管理ツールが急速に普及しています。手軽で低コスト、かつ24時間いつでもアクセスできるこれらのツールは、心の悩みを抱える多くの人々にとって新たな支えとなりつつあります。しかし、技術の進化が加速する一方で、その安全性やプライバシー保護、そして医療としての倫理観が追いついているのかという懸念も浮上しています。本記事では、メンタルヘルスケアにおけるAIの可能性と、解決すべき倫理的課題について詳しく解説します。

AIメンタルヘルスツールの台頭と主要な背景

なぜAIセラピーが選ばれるのか

AIセラピーは、チャットボットやアプリを通じて認知行動療法(CBT)やマインドフルネス、気分トラッキングなどの手法を提供します。多くのユーザーがこれを支持する理由は、コストが安く、専門家への予約が難しい環境でもすぐに利用できる点にあります。また、対面での会話に抵抗を感じる人にとって、心理的ハードルが低いことも大きな魅力となっています。

補完ツールとしての位置付け

専門家の多くは、AIツールを「セラピストの代替」ではなく「サポートツール」として位置付けています。ジャーナリングや気分の記録など、専門的な治療の合間の補助として活用することで、個人のメンタルヘルス管理を日常的に助ける役割が期待されています。

主要な倫理的・技術的懸念

AIによるサポートには、プライバシーやデータセキュリティの問題がつきまといます。セラピーという極めて個人的で繊細な情報が、どのように保存・管理されるのかという点は深刻な懸念材料です。また、AIが深刻なメンタルヘルスの危機(自殺念慮など)を正しく認識できず、不適切なアドバイスをしてしまうリスクも指摘されています。

テクノロジーと人間的ケアが交差する今後の展望

「人間」の不可欠な役割

AIはパターン認識に優れていますが、文脈、感情の機微、非言語コミュニケーションを真に理解することはできません。深刻なトラウマや精神疾患のケアには、深い共感や倫理的判断を伴う「人間」によるセラピーが不可欠です。AIが効率性を高める一方で、治療の核となる信頼関係の構築は人間にしか成し得ない重要な領域です。

ハイブリッド型ケアモデルへの移行

今後は、AIが診断や意思決定をサポートし、最終的な治療方針を専門家が判断する「ハイブリッド型ケア」が標準化していくでしょう。AIは「アクセスの向上」を担い、人間は「質の高い判断」を担うという分業体制こそが、技術の恩恵を安全に享受するための鍵となります。

信頼を維持するための倫理的枠組み

AIメンタルヘルスツールが真に社会へ貢献するためには、厳格な規制と透明性の確保が欠かせません。どのようなデータがどのように使われているかの明確な開示、バイアスのない公平なアルゴリズムの構築、そして何より「AIは万能ではない」という限界をユーザーが正しく理解できるような教育が必要です。イノベーションを止めるのではなく、患者の尊厳と安全を最優先にする倫理的設計こそが、次世代のメンタルヘルスケアの道筋となるでしょう。