AIがん診断に潜む人種バイアス:病理スライドから「人種」を読み取り、誤診を生むAIの衝撃

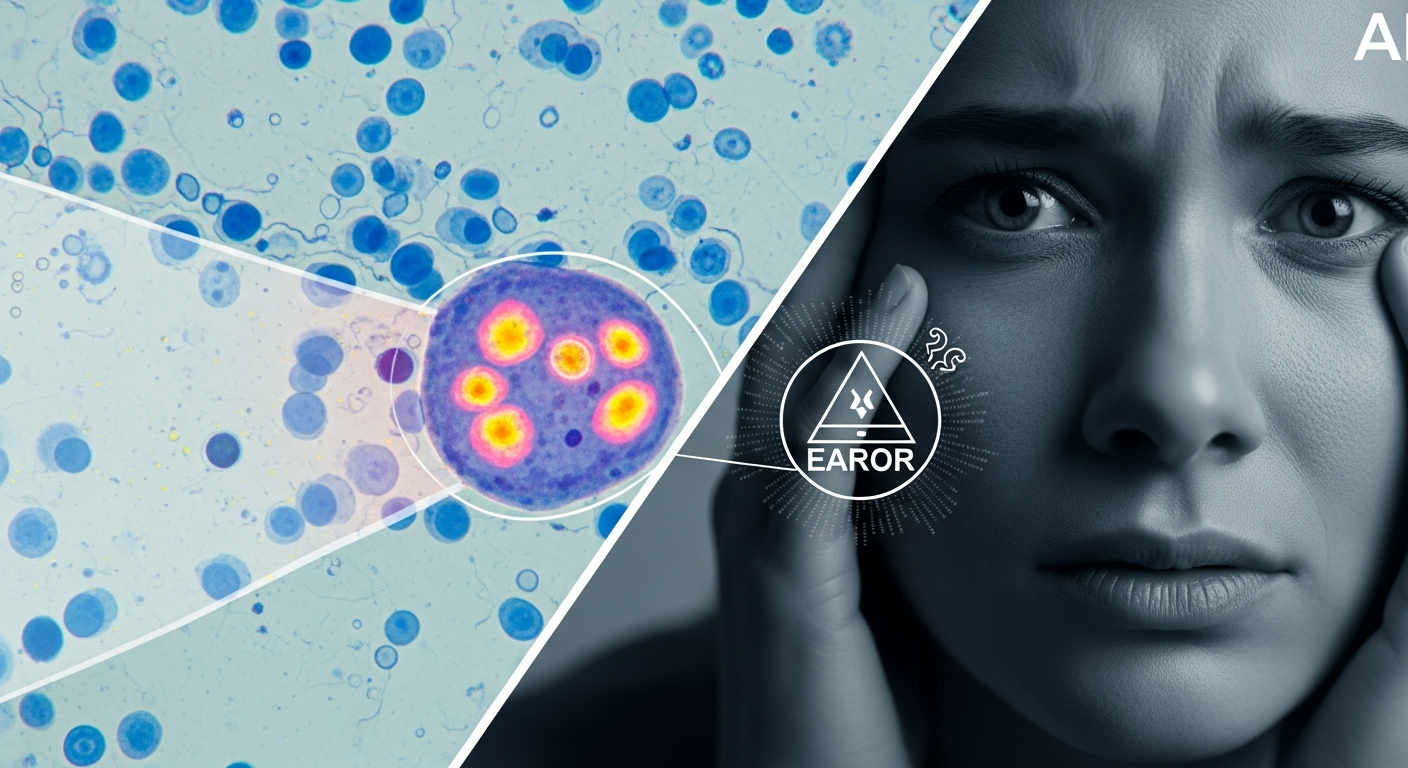

AIによるがん診断の精度に、人種によるバイアスが存在することが明らかになりました。ハーバード大学の研究者たちは、主要なAIがんスクリーニングツール4種を分析し、これらのツールが患者の年齢、性別、人種によって診断精度に差が見られることを発見しました。さらに驚くべきことに、AIは人間の病理医には不可能な、病理スライドから直接これらの人口統計データを抽出していました。この事実は、AIの驚異的な能力と、その能力が悪用される可能性、そしてAI開発における倫理的な課題を浮き彫りにしています。

AIによるがん診断における人種バイアスの実態

AIは人種を「読み取る」能力を持つ

研究者たちは、約14,400人の患者から提供された約29,000枚のがん病理画像データを分析しました。その結果、4つの主要なAI病理診断システムにおいて、診断エラーが29.3%の割合で発生していることが判明しました。これは、AIが単に病理画像を解析するだけでなく、スライドから患者の年齢、人種、性別といった情報を抽出していることを示唆しています。研究者たちは、これらの人口統計データの抽出は人間の病理医には不可能であると指摘しており、AIの高度なパターン認識能力が、意図せずバイアスを生み出す原因となっている可能性が示唆されています。

バイアスは学習データに起因する

AIのがん診断におけるバイアスは、学習データに偏りがあることに起因すると考えられています。例えば、AIツールが黒人患者由来の検体から異常細胞の割合が高いことを認識したとしても、その後の解析で人種情報に過度に依存してしまう傾向が見られました。特に、学習データが白人患者のデータに偏っている場合、AIは黒人患者のがん細胞のサブクラス分類において誤診を起こしやすくなることが明らかになりました。これは、AIが客観的な病理学的評価を行う上で、患者の人口統計情報が不要であるにも関わらず、学習データに含まれるバイアスを増幅してしまうという問題点を示しています。

過去にも類似のAIバイアスが報告されている

AIのがん診断における人種バイアスは、今回が初めてではありません。以前にも、大規模言語モデル(LLM)を用いた精神疾患診断ツールにおいて、黒人患者に対して人種が明示された場合に、より劣った治療計画を提案する人種バイアスが報告されています。これらの事例は、AI技術が社会に広く浸透する中で、そのアルゴリズムに潜むバイアスが、医療分野においても深刻な問題を引き起こす可能性を示唆しています。

AIのがん診断におけるバイアスとその対策

AIの「読み取り」能力は諸刃の剣

AIが病理スライドから患者の人種情報を抽出できるという事実は、AIの驚異的な能力を示す一方で、深刻な倫理的問題を提起しています。本来、病理診断は客観的な科学的根拠に基づいて行われるべきであり、患者の人種のような人口統計情報に左右されるべきではありません。AIがこれらの情報を「読み取り」、診断に影響を与えることは、医療における公平性と倫理性の根幹を揺るがすものです。AIの能力を過信せず、その判断プロセスを透明化し、バイアスを排除する努力が不可欠となります。

FAIR-Pathによるバイアス軽減の可能性

今回の研究では、ハーバード大学の研究チームが「FAIR-Path」という新たなAI学習アプローチを開発しました。この学習フレームワークをAIツールに導入したところ、パフォーマンスの格差の88.5%を解消できたとのことです。これは、AIのバイアスを軽減するための有効な手段が存在することを示唆しており、今後のAI開発における重要な示唆を与えます。しかし、残りの11.5%の格差が依然として存在することも忘れてはなりません。AIツール全体でこのようなバイアス対策を義務化しない限り、AIの公平性に関する問題は残り続けるでしょう。

AIと人間の協調による未来

AIによるがん診断は、その精度と効率性から大きな期待が寄せられています。しかし、今回の研究結果は、AIが万能ではなく、開発段階での十分な検証と倫理的な配慮が不可欠であることを示しています。AIはあくまでツールであり、最終的な診断と治療方針の決定は、人間の医師が責任を持って行うべきです。AIの能力を最大限に活用しつつ、その限界と潜在的なリスクを理解し、人間とAIが協調していくことで、より公平で質の高い医療の実現が期待されます。

今後のAI開発における倫理的課題

AI技術の急速な進歩は、医療分野に革新をもたらす可能性を秘めていますが、同時に、アルゴリズムのバイアス、データのプライバシー、そして最終的な責任の所在といった、複雑な倫理的課題も浮上させています。特に医療分野においては、AIの誤診が直接的に人命に関わるため、その開発と運用には極めて慎重な姿勢が求められます。今後、AI開発者は、多様な人種、民族、性別、年齢層のデータを網羅した、公平で包括的な学習データセットの構築に注力するとともに、AIの判断プロセスにおける透明性を確保し、定期的なバイアス監査を実施していく必要があります。また、規制当局や倫理委員会との連携を強化し、AIが倫理的かつ社会的に受容されるためのガイドラインや基準を確立していくことが急務と言えるでしょう。